1. 摘要

本论文提出了一种基于知识图谱增强的语言代理推荐系统框架,称为 KGLA(Knowledge Graph Enhanced Language Agents)。该框架旨在解决当前推荐系统中基于语言模型的代理在模拟用户-物品交互时存在的关键问题,即对用户和物品之间关系的理解不足,导致用户画像不准确、推荐效果不理想。

论文的核心思想是利用知识图谱中的路径来揭示用户与物品之间的复杂关系,这些路径包含了用户偏好的深层次原因,从而帮助生成更加丰富的用户画像。在该框架中,用户和物品在知识图谱中被表示为节点,知识图谱的路径被转化为自然语言描述,整合到代理的模拟交互过程中,使得模拟结果更为准确且更符合真实场景,从而提升推荐系统的性能。

实验结果表明,KGLA在三个广泛使用的推荐系统基准数据集上显著提升了推荐性能,相比于当前最好的基线方法在NDCG@1指标上提升了33%至95%的推荐准确性。

摘要中的主要贡献包括:

- 提出了一个创新的框架,将知识图谱中的信息集成到语言模型代理中以提升推荐系统的表现。

- 设计了三个关键模块:路径提取、路径翻译和路径整合,以将知识图谱路径信息转化为可供语言模型理解的文本形式,并应用于用户画像的构建。

- 在多个公开数据集上的实验表明,与传统方法相比,该框架在推荐精度方面表现出显著的优势。

2. 引言

论文的引言部分首先阐述了大型语言模型(Large Language Models, LLMs)在对话和决策任务中的强大能力,尤其是在模拟人类行为和用户-物品交互方面的潜力。近年来,LLM代理(LLM Agents)在推荐系统中得到了应用,通过模拟用户和物品的交互行为来生成个性化推荐。然而,现有的LLM代理在模拟用户画像时面临一个核心问题:缺乏对用户与物品之间关系的深刻理解,导致用户画像不准确,推荐效果也受到影响。

当前方法的局限性

现有的方法通常采用简单的文本描述来表示用户和物品的特征,并通过代理记忆(Agent Memory)来记录用户偏好。然而,由于缺乏足够的上下文和逻辑支撑,生成的用户画像往往过于笼统和通用,难以反映用户的真实兴趣。例如,如果仅用简短的描述来模拟用户的喜好,LLM代理很难识别出用户偏好的具体原因,因此可能推荐出与用户兴趣不匹配的物品。

解决方案:知识图谱增强

为了解决上述问题,论文提出利用知识图谱(Knowledge Graph, KG)来增强LLM代理的能力。知识图谱包含丰富且可靠的实体关系,可以为用户的选择提供更加充分的逻辑支撑。例如,知识图谱路径可以描述用户为何偏好某一物品的潜在原因(如“用户提到的功能被描述为…”,其中该路径可以揭示用户兴趣的具体细节)。通过将知识图谱中的信息转化为自然语言描述,语言代理可以更好地理解用户偏好的依据,从而构建更加精确的用户画像。

KGLA框架简介

基于上述思路,论文提出了KGLA(Knowledge Graph Enhanced Language Agents)框架,将知识图谱与LLM代理结合应用于推荐系统。具体而言,在推荐系统的模拟情境中,用户和物品被映射到知识图谱中的节点,知识图谱路径信息被转化为自然语言嵌入到代理的模拟过程中。通过这种方式,语言代理可以在交互中获取用户选择的原因,并将这些信息更新到用户画像中,从而提高模拟的真实性和准确性。

框架的创新点

KGLA框架的三个核心模块包括:

- 路径提取模块:从知识图谱中提取用户和物品之间的关系路径。

- 路径翻译模块:将知识图谱路径转化为自然语言描述,以便代理更好地理解。

- 路径整合模块:将转换后的知识图谱路径信息整合到代理的交互和推荐过程中,以增强用户画像。

实验与成果

通过一系列实验,论文验证了KGLA框架在推荐系统中的有效性。实验结果表明,与当前最佳的基线方法相比,KGLA显著提升了推荐精度,证明了在语言代理中加入知识图谱的有效性。

引言总结

引言部分总结指出,KGLA框架通过结合知识图谱和LLM代理,有效提升了推荐系统的模拟和预测能力,解决了现有方法中用户画像不准确的问题。此框架不仅提高了推荐系统的性能,也为其他使用知识图谱与语言代理结合的任务提供了新的思路。

3. 相关工作

本章讨论了与本研究相关的三个主要领域,即大型语言模型(LLM)代理、推荐系统中的LLM代理应用,以及知识图谱(KG)与LLM代理的结合。每个领域的背景和现有方法的局限性为KGLA框架的提出奠定了基础。

3.1 大型语言模型代理

LLM代理因其在多任务环境中的强大对话和决策能力而受到广泛关注。LLM代理的核心能力包括:

- 采取行动:代理能够根据提示执行特定操作或做出决策。

- 反思能力:在行动之后,代理可以根据反馈反思其决策,优化以后的表现。

- 记忆功能:代理可以存储过去的反思结果,以便在未来的决策中加以利用。

在推荐系统中,LLM代理通常通过交互模拟用户的行为。例如,代理可以选择用户偏好的物品并提供推荐顺序,并根据反馈动态调整用户画像。然而,尽管LLM代理在生成更具解释性和透明的推荐内容方面有显著优势,但其在理解复杂用户行为和偏好方面仍存在挑战。

3.2 推荐系统中的LLM代理

随着LLM代理的普及,研究人员将其应用于推荐系统的两个主要方向:

- 推荐器导向:在此方向中,代理被设计为具备规划、推理、记忆和工具使用等多方面能力,以便为用户提供更合适的推荐。例如,RecMind和InteRecAgent均开发了单一代理,通过强化推荐的多种能力来改进推荐效果。

- 模拟导向:该方向关注使用代理来模拟用户的行为和物品特征。例如,RecAgent和Agent4Rec让代理分别代表用户和物品,从而模拟用户和推荐系统之间的交互。此外,AgentCF利用用户代理和物品代理的动态交互来更新用户偏好,最终用于生成推荐内容。

KGLA的研究属于第二类“模拟导向”推荐系统。然而,之前的模拟方法仅利用代理记忆构建用户画像,忽略了高质量用户记忆的构建,因而推荐效果可能受到影响。为解决这一问题,KGLA通过引入知识图谱信息,以增强代理对用户偏好的理解。

3.3 知识图谱与LLM代理的结合

知识图谱是一种结构化的知识表示形式,广泛应用于问答系统中,以帮助LLM推理和解答问题。已有研究表明,知识图谱中的关系路径可用于提供推理支持。例如,Jiang等人提出了“KG-Agent”框架,让LLM通过遍历知识图谱节点来寻找问题答案。然而,这类方法大多用于回答问题的推理任务,而KGLA中知识图谱与LLM的结合方式与传统推理任务有所不同。

KGLA在推荐系统中的应用情境为“归纳式”任务(inductive task),即已知用户节点和目标物品节点,要求LLM分析两节点间的路径并总结用户偏好的关键原因。KGLA首次采用LLM代理通过归纳分析知识图谱路径来更新用户画像,从而改进推荐效果。这一创新点将KGLA框架与现有工作区分开来,使其更适用于推荐系统中的用户行为模拟。

总结

本章的相关工作讨论表明,尽管LLM代理在模拟推荐任务中有显著进展,但用户画像的精准度仍面临挑战。而知识图谱因其强大的逻辑关系表现力,成为丰富用户画像的潜在工具。通过整合知识图谱和LLM代理,KGLA提出了一个新颖的框架,旨在通过更真实的模拟用户偏好,改进推荐系统的表现。这为本研究的主要贡献奠定了理论基础。

4. 方法

本章介绍了KGLA框架的详细设计。KGLA框架结合知识图谱(Knowledge Graph, KG)和大型语言模型代理(LLM Agent),通过将知识图谱中的信息转化为自然语言并整合到代理的交互和推荐过程中,从而构建更精准的用户画像并提升推荐效果。该方法主要分为符号定义和问题描述、整体框架、路径提取、路径转换(2跳路径和3跳路径)、以及路径整合五个部分。

4.1 符号定义与问题描述

论文首先定义了推荐系统和知识图谱的基本符号:

- 推荐系统:用户集记为 ( U ),物品集记为 ( I )。每个用户 ( u \in U ) 有一段交互历史,记为 ([i_1, i_2, \ldots, i_n])。

- 知识图谱:知识图谱 ( G ) 表示为包含三元组的集合 ( {(e_h, r, e_t) \mid e_h, e_t \in E, r \in R} ),其中 ( e_h ) 和 ( e_t ) 为图谱中的头实体和尾实体,( r ) 是它们之间的关系。

在知识图谱中,用户和物品都可以被视为节点,路径可以解释用户与物品间的潜在偏好关系,从而帮助改进用户画像。在此基础上,问题被定义为如何利用知识图谱中的信息来增强LLM代理的推荐能力。

4.2 整体框架

KGLA框架的设计分为三个阶段:

- 初始化阶段:初始化所有用户和物品的代理记忆。用户记忆以模板句式“我喜欢…”来开始,而物品记忆则包含物品的标题和类别。

- 模拟阶段:包括自主交互和反思两个子阶段。在此阶段,代理通过模拟用户-物品的交互来更新用户和物品的画像。对于每次交互,用户代理基于用户与物品的2跳和3跳关系信息,在正负物品之间做出选择,并在反思阶段更新记忆。

- 排序阶段:生成推荐列表。用户代理基于用户和候选物品的画像及知识图谱路径信息,生成排序列表。

4.3 知识图谱路径提取

该模块从知识图谱中提取用户与物品之间的关系路径,作为用户选择的潜在依据。路径的长度分为2跳路径和3跳路径:

- 2跳路径:例如用户 ( u ) 与物品 ( i ) 之间的路径 ( u \rightarrow e_1 \rightarrow i ),此路径可以反映出中间实体 ( e_1 ) 如何连接用户和物品。

- 3跳路径:例如用户 ( u ) 与物品 ( i ) 之间的3跳路径 ( u \rightarrow e_1 \rightarrow e_2 \rightarrow i ),更为详细地展示了用户与物品间的复杂关系。

提取出的2跳和3跳路径将用于路径转换模块,以便后续整合到代理记忆中。

4.4 路径转换:通过文本表达2跳路径

路径转换模块负责将从知识图谱中提取的路径转化为自然语言描述,便于LLM理解。对于2跳路径,转换过程包括以下步骤:

- 路径分组:按关系对路径进行分组,将具有相同关系对的路径归为一类,以减少文本冗余。

- 生成自然语言描述:将路径描述转化为人类语言,例如,对于路径 ( u \text{ 提到 } e_1 \rightarrow e_1 \text{ 描述为 } i ),将其转化为“用户提到的特征 e_1 被描述为该物品的特征”。

这种简化后的描述既缩短了文本长度,又使代理能够更好地理解用户与物品之间的关系。

4.5 路径转换:通过文本表达3跳路径

3跳路径通常比2跳路径包含更多的节点和关系,因此在转换时需要更加关注简化和关键信息提取。转换过程包括以下步骤:

- 构建无信息实体集:先分析正负物品路径,将在正负物品中均出现的中间实体加入无信息实体集中,以避免信息冗余。

- 路径简化:仅保留那些描述性强、能够体现用户偏好的实体,例如特征词或类别词。

- 文本生成:使用过滤后的描述性实体来生成自然语言文本,确保代理在反思阶段能够更好地利用该信息更新用户偏好。

这种方法不仅减少了3跳路径的文本长度,还提升了路径对用户选择偏好的解释力。

4.6 路径整合

路径整合模块负责将转换后的2跳和3跳路径文本整合到模拟和排序阶段,以提升用户画像的准确性:

- 自主交互阶段:在代理自主选择物品时,整合2跳路径文本来帮助代理分析用户选择的可能原因。

- 反思阶段:在代理做出选择后,通过整合2跳和3跳路径文本,让代理反思选择的正确性,并更新用户和物品的记忆。

- 排序阶段:在生成最终推荐列表时,利用用户记忆和2跳路径信息,生成符合用户兴趣的物品排序。

总结

本章的方法部分详细介绍了KGLA框架的构建过程,从符号定义、整体架构设计到具体的路径提取、转换和整合方法。通过在LLM代理中引入知识图谱路径信息,KGLA不仅丰富了用户画像,提升了推荐准确性,也为未来的KG和LLM代理的结合应用提供了新思路。

5. 实验

本章展示了KGLA框架在推荐系统任务中的实验结果。实验的主要目的是验证KGLA框架在推荐精度上的提升效果,并分析知识图谱(KG)信息在用户画像构建中的作用。实验部分涵盖了实验设置、总体性能比较、消融实验、代理记忆的影响分析、推荐排序的影响分析以及对输入文本长度的优化效果。

5.1 实验设置

实验基于以下三个推荐数据集进行:CDs、Clothing 和 Beauty。每个数据集均包含了用户和物品的交互数据以及相关的知识图谱信息。为了更好地模拟用户与物品的互动,实验从每个数据集中随机抽取了100个用户及其交互历史。

- 数据集:包含了用户、物品、特征、品牌和类别等实体,以及八种类型的关系(如用户购买、用户提到的特征、物品所属类别等)。

- 评价指标:采用NDCG@K (Normalized Discounted Cumulative Gain) 来评估推荐效果,K设为1、5和10。

- 对比方法:与传统的推荐算法(如BPR、Popularity、BM25)、深度学习推荐方法(如SASRec)和基于LLM的推荐方法(如LLMRank和AgentCF)进行对比。

5.2 总体性能比较

在不同数据集上的总体性能如表格所示,KGLA框架在所有评价指标上均显著优于其他对比方法,具体表现如下:

- 推荐准确性提升:在NDCG@1指标上,KGLA相比于最佳基线方法在CD、Clothing和Beauty数据集上的性能分别提升了95.3%、33.2%和40.8%。这一结果表明,整合知识图谱信息显著增强了模型的推荐准确性。

- LLM方法的优越性:LLM方法(如LLMRank和AgentCF)的推荐性能优于传统和深度学习方法,表明LLM的通用性和强大的信息整合能力在推荐任务中具有优势。而KGLA通过结合KG信息进一步优化了LLM的表现。

5.3 消融实验:不同KG信息对性能的贡献

为了分析知识图谱不同信息对推荐性能的影响,研究进行了消融实验,将KGLA框架的KG信息分解为2跳路径信息和3跳路径信息,并观察各自的贡献。结果显示:

- 2跳路径信息:仅整合2跳路径信息时,推荐精度有所提升,证明了2跳路径在捕获用户偏好中的重要性。

- 3跳路径信息:在整合2跳路径的基础上加入3跳路径信息后,推荐精度进一步提升,表明3跳路径提供了更丰富的用户偏好背景。

- 完全整合:整合2跳和3跳路径信息可以显著提升模型的总体性能,说明这两种路径信息在用户偏好理解上互为补充。

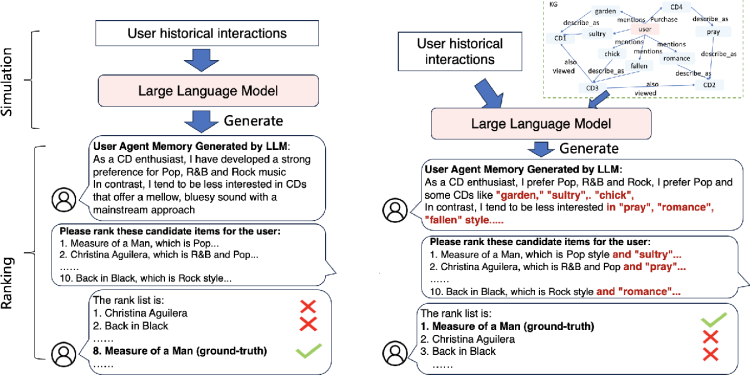

5.4 用户代理记忆的影响分析

实验进一步分析了知识图谱信息对用户代理记忆(User Agent Memory)质量的影响。通过一个案例研究展示了KGLA如何提升用户画像的精确度。在模拟过程中,代理能够基于正负样本总结出用户更偏好的特征(如“花园风格”、“性感”等),并将其更新到用户记忆中,从而在后续推荐中更准确地匹配用户兴趣。

该分析表明,KGLA整合KG信息能够有效丰富用户记忆中的偏好细节,从而显著改善推荐的精确度。

5.5 排序阶段的影响分析

实验进一步验证了经过KG信息优化的用户记忆对推荐排序结果的影响。在推荐排序阶段,用户代理能够基于更全面的用户画像对候选物品进行排序,从而推荐更符合用户偏好的物品。在案例中,代理能够识别出与用户记忆中偏好特征重合更多的候选物品,进一步提升了推荐的准确性。

5.6 对输入文本长度的优化

KGLA的一个关键目标是优化知识图谱信息的描述长度,使得输入文本简洁而信息充分。在此实验中,比较了2跳和3跳路径信息的原始文本长度与KGLA生成的简化文本长度:

- 2跳路径:KGLA生成的文本较原始路径文本缩短了约60%,保留了关键信息同时减少了输入量。

- 3跳路径:KGLA生成的文本在3跳路径上缩短了约98%,大幅度减少了输入量并有效避免了冗余信息。

这种文本压缩显著降低了LLM的处理负担,提升了框架的效率。

总结

实验结果验证了KGLA框架在推荐任务中的有效性,显示出知识图谱信息的整合对LLM代理理解用户偏好的重要性。在所有测试的数据集上,KGLA均显著超越了现有基线方法,并通过优化输入文本长度进一步提高了模型的效率。

6. 结论

在结论部分,论文总结了KGLA框架的贡献及其在推荐系统任务中的表现。KGLA框架通过结合大型语言模型(LLM)代理和知识图谱(KG),显著提升了推荐系统的推荐准确性和用户偏好的理解精度。以下是结论的主要内容和研究贡献:

6.1 研究的背景与挑战

大型语言模型代理在推荐任务中展现出很大潜力,但在用户画像构建方面存在显著挑战。现有的LLM代理方法多半依赖于简单的用户和物品描述,缺乏对用户偏好的逻辑支持,导致生成的用户画像不够精确,从而影响推荐性能。针对这一问题,本研究提出了一个知识图谱增强的框架KGLA,通过整合知识图谱中的路径信息,为用户偏好构建提供更深层次的解释和支撑。

6.2 KGLA框架的创新之处

KGLA框架的核心创新在于将知识图谱信息以自然语言的形式整合到LLM代理的模拟和推荐过程中,从而使代理能够更好地理解用户偏好背后的逻辑。KGLA设计了三个模块:

- 路径提取:从知识图谱中提取用户与物品之间的路径信息。

- 路径转换:将路径信息转化为自然语言描述,使代理能够在推荐过程更容易理解用户偏好的依据。

- 路径整合:将转换后的路径信息融入到代理的记忆更新和推荐排序中,帮助代理在生成推荐列表时更准确地符合用户兴趣。

这些模块共同作用,使得KGLA框架能够在交互过程中逐步更新和优化用户画像,使推荐结果更接近真实用户偏好。

6.3 实验验证与结果

实验结果表明,KGLA框架在多个基准数据集上显著提升了推荐性能,与当前的最佳基线方法相比,在NDCG@1指标上的提升达到了33%-95%。这些结果验证了知识图谱信息在提升推荐系统中的用户偏好理解和画像构建方面的有效性。

此外,KGLA通过压缩知识图谱路径信息的文本长度,优化了输入文本量,显著提升了框架的计算效率。在路径信息经过简化和整合后,LLM代理能够在减少冗余信息的前提下准确捕捉关键偏好因素,从而更有效地支持推荐任务。

6.4 未来研究方向

论文最后指出了KGLA的潜在扩展方向,主要包括:

- 更广泛的KG+LLM应用场景:KGLA框架在提升推荐系统的精度上表现优异,这表明其框架可以推广到其他需要用户行为模拟和偏好理解的任务中。

- 多跳路径的扩展:未来可以探索更长路径的信息整合,进一步增强对复杂用户偏好的理解。

- 实时更新的代理记忆:随着用户兴趣和行为的动态变化,KGLA的框架可以进一步优化,使代理的记忆可以实时更新,从而更准确地反映用户的最新偏好。

总结

总体而言,KGLA框架为知识图谱和语言模型代理的结合提供了一个创新性的方法,在推荐系统中展现了显著的优势。通过将知识图谱信息转化为自然语言并融入用户画像构建,KGLA有效提升了用户偏好的精确度,显著提高了推荐系统的性能。这一框架为未来的推荐技术研究及其他KG+LLM的应用提供了新的思路和启发。

![Slow Perception: Let’s Perceive Geometric Figures Step-by-step[缓慢感知:让我们逐步感知几何图形]-AI论文](https://assh83.com/wp-content/uploads/2025/01/1-1-360x180.png)

![Large Concept Models:Language Modeling in a Sentence Representation Space[大型概念模型:在句子表示空间中的语言建模]-AI论文](https://assh83.com/wp-content/uploads/2025/01/image-1-360x180.png)

![Cultural Evolution of Cooperation among LLM Agents[大型语言模型代理间合作的文化演化]-AI论文](https://assh83.com/wp-content/uploads/2025/01/image-360x180.png)

![Do NOT Think That Much for 2+3=? On the Overthinking of o1-Like LLMs[不要过度思考2+3等于几 在类LLM的过度思考上]-AI论文](https://assh83.com/wp-content/uploads/2025/01/1-2-350x250.png)

![Slow Perception: Let’s Perceive Geometric Figures Step-by-step[缓慢感知:让我们逐步感知几何图形]-AI论文](https://assh83.com/wp-content/uploads/2025/01/1-1-350x250.png)

![Ensembling Large Language Models with Process Reward-Guided Tree Search for Better Complex Reasoning[结合大型语言模型与过程奖励引导的树搜索以提升复杂推理能力]-AI论文](https://assh83.com/wp-content/uploads/2025/01/1-350x248.png)

![Large Concept Models:Language Modeling in a Sentence Representation Space[大型概念模型:在句子表示空间中的语言建模]-AI论文](https://assh83.com/wp-content/uploads/2025/01/image-1-350x250.png)